AI in Vertec: der neue LLM Client in Python 3

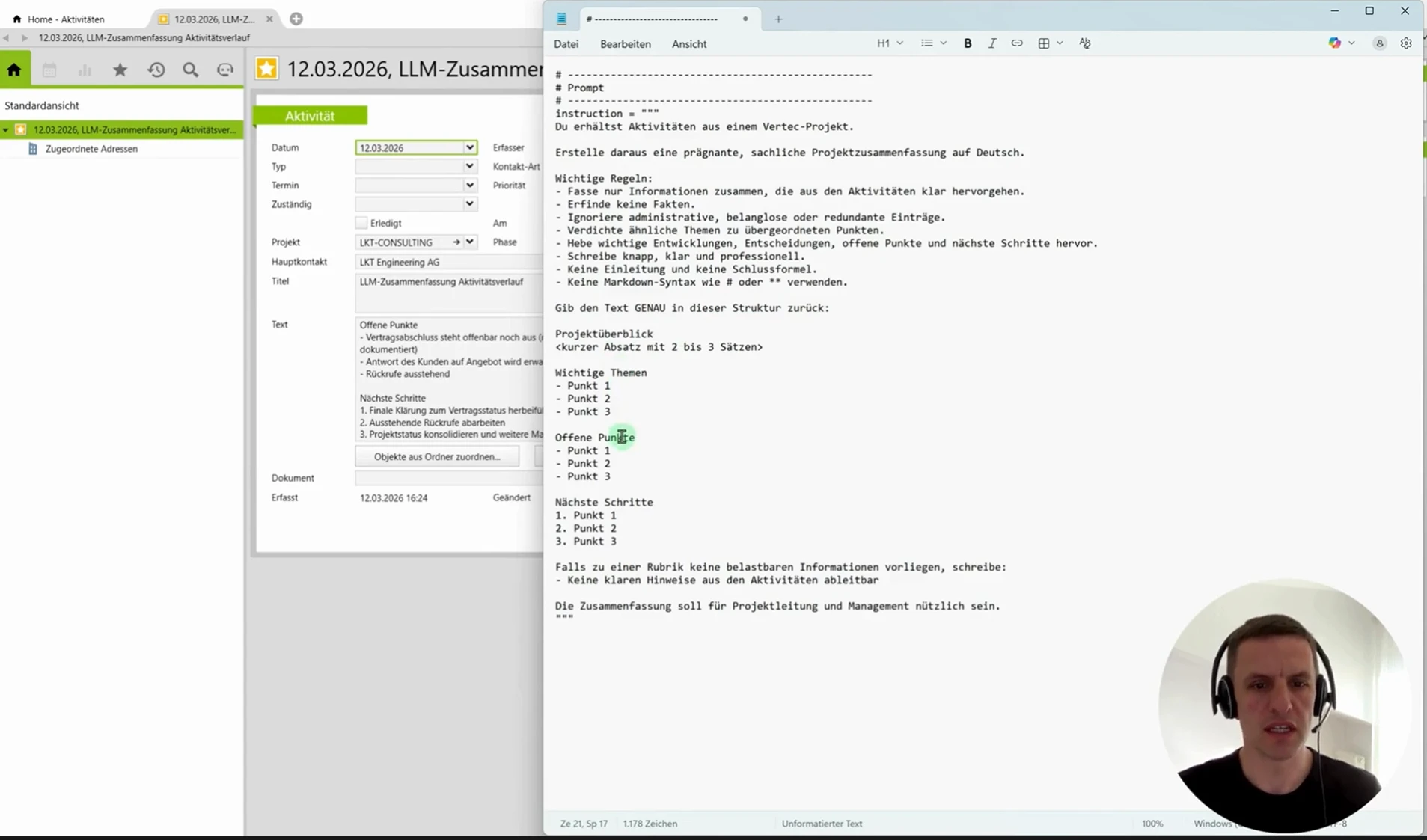

Mit dem neuen LLM Client in Python 3 eröffnen sich attraktive AI-Anwendungsfälle in Vertec. Seit der Einführung von Python Version 3 ist es nun möglich, einen generischen LLM Client via Script zu verwenden. Im KB Artikel ist die Nutzung detailliert erklärt.

Die Voraussetzungen sind denkbar einfach: Mit Vertec Version 6.8.0.17 oder höher und einem API Key von OpenAI, Anthropic oder Google kann direkt begonnen werden. Im Video zeigen wir drei verschiedene Anwendungsfälle aus den Bereichen Rechnung, Aktivitäten und Projektstatus.

Für die drei Beispiele und generell gilt: Über Anpassungen am Prompt, welcher im Script eingebettet ist, kann die AI-Antwort gesteuert werden. Strukturierung, Länge, Schwerpunkte – sagen Sie der AI in natürlicher Sprache, was zurückgeliefert werden soll. Im Script steuern Sie ausserdem, welche Daten ans LLM geschickt werden. Aktivitäten, Leistungen, Spesen etc.

Welche Anwendungsfälle setzen Sie mit dem neuen LLM Client um? Wir freuen uns auf Ihr Feedback im Vertec Forum.